Les ondes 1.0 – Généralités

Depuis l’avènement du téléphone mobile, et en particulier depuis l’utilisation massive des technologies sans fil, il est courant d’entendre des affirmations sur les ondes. Toutefois, ce n’est pas une première puisque les «on-dits» ont été très présent pour les autres innovations maintenant complètement passées dans la vie courante, telle que la télévision ou le four à micro-ondes. Il est parfaitement légitime de se demander ce que ces ondes ont à cacher, surtout qu’elles sont invisibles, pour certaines intangible et pouvant traverser des couches de matière. Il est tout aussi logique d’avoir peur d’exposer son être, son enfant ou ses aliments à ce type de dangers potentiels.

Toutefois, il est aussi nécessaire de cerner le problème avant de tenter de savoir s’il en est réellement un. Nous allons donc nous demander ce qu’est réellement une onde. Si elles peuvent être dangereuses pour la santé et dans quelles limites il est judicieux de les laisser entrer dans nos vies.

Malheureusement, les ondes, y’en a partout :

il est impossible d’y échapper, mais qu’est-ce donc que ce nouveau fléau ?

D’abord parler d’onde tout court est une erreur ; une onde est une perturbation d’un espace possédant un état stable, qui intervient temporairement. En gros, quand vous lancez un rocher dans la surface plane d’un lac et qu’il se produit des vagues, vous venez de créer une onde, et dans ce cas, le lac reviendra à un état stable, c’est-à-dire avec une surface plane, dès que la perturbation se sera dissipée.

Une onde n’est pas donc pas une chose, mais un état, plus ou moins temporaire, comportant un milieu (le lac, le vide ou l’air) que l’on va déranger par le biais d’une action (le rocher, l’antenne d’un smartphone ou d’une borne d’émission).

Une onde est généralement définie par la fréquence de la perturbation qu’elle inflige au milieu :

> soit une puissance (l’énergie qui a été nécessaire à la produire et qu’elle dissipe)

> une fréquence (le nombre de modification par seconde)

> une longueur (le type d’onde provoquée, qui dépend du milieu).

Dans le cas de notre lac, elle serait mesurée par le nombre de vagues provoqué par le rocher par seconde – c’est la fréquence de l’onde mesurée en hertz (Hz) -, la hauteur des vagues – c’est la puissance de l’onde mesurée, dans ce cas particulier, en Joule (J) et l’énergie dynamique qu’elles comportent c’est-à-dire la distance avant laquelle la vague n’est plus perceptible à la surface du lac – que l’on mesure cette fois en Joule par Mètre.

Maintenant que l’on sait ce qu’est une onde, il faut définir le milieu qui nous intéresse dans cette information : le lac est un milieu physique. Il est visible et tangible.

Ce n’est pas le cas de notre sujet du jour : les ondes électromagnétiques.

Les ondes électromagnétiques, qui comporte une référence à l’électricité et au magnétisme qui ne sont pas déconnecté l’un de l’autre. Il est possible de créer un champ magnétique avec de l’électricité (c’est en fait toujours le cas) et il est possible de créer de l’électricité avec des aimants (par induction. Oui, c’est bien la même que celle de votre table de cuisson).

Il existe aussi des ondulations électromagnétiques que nous connaissons bien et que nous sommes capables de détecter à partir de nos sens seuls. La force électromagnétique qui produit des ondes autour de 550 nanomètres de longueur s’appelle la lumière et nous la voyons, en partie en tout cas, avec nos yeux.

Comme toujours pour une onde, nous allons pouvoir la mesurer en fréquence en hertz (Hz) – traduire par couleur dans le spectre visible (ou invisible puisqu’il existe des lumières que nous ne voyons pas), par une longueur que l’on calcule en mètre (m) et par une puissance d’émission en fonction du but recherché, elle peut être calculé en Watt (W), en Joule (J), en élection-volt (eV) ou en volt par mètre (V/m). Si la fréquence à un impact sur une zone, elle peut aussi être mesurée en volt par mètre carré (V/m²).

Une onde que l’on voit ?

Eh bien oui, même si celle-ci est plus complexe que ça, c’est un raccourci acceptable.

Nous sommes donc entouré d’ondes, particulièrement quand le soleil brille ou quand nous avons allumé la lumière.

Celle-ci est par défaut blanche dans le vide, mais elle est perturbée différemment par chaque milieu qu’elle rencontre : c’est pour cela que le ciel est bleu et qu’il n’est pas d’un bleu uniforme. L’eau déforme une partie de longueur d’onde les plus longue, rouge et infrarouge, tandis que l’atmosphère terrestre diffracte ou filtre les parties les plus courtes violet et ultraviolet.

Chaque onde possède des propriétés particulièrement vis-à-vis du vivant. Ces particularités sont d’autant plus exprimées que la puissance (la source d’énergie qui provoque l’onde) est importante.

Dans les deux cas, les extrêmes provoquent des dégâts au vivant : les infrarouges correspondent aux rayonnements thermiques, les ultraviolets possèdent des propriétés mutagènes, et décomposantes capables de casser certaines molécules organiques. Ils sont la cause du vieillissement de la peau, du bronzage, des coups de soleil ou de mélanomes (dans les pires cas).

Le soleil provoque une panel d’ondes suffisantes pour effleurer les limites d’un seuil : la faculté d’ionisation.

L’ionisation est une action qui permet d’enlever ou d’ajouter des charges électriques à des molécules ou des atomes, ce qui leur fait perdre leur équilibre électrique devenant ainsi des ions. Les molécules ainsi transformées n’ont plus les mêmes caractéristiques. Ce qui est néfaste pour les cellules du corps humain (et des animaux et plantes aussi d’ailleurs.)

Comme on peut le voir, même les ondes lumineuses peuvent provoquer des dégâts.

Alors qu’en est-il du reste du spectre électromagnétique ?

Les ultraviolets sont la partie la plus haute du rayonnement solaire, « plus que violet » comme leur nom l’indique, c’est eux qui se situent dans la limite entre les rayonnements non-ionisants et ionisants. Certains de ceux-ci – utilisés en boite de nuit, rendent simplement certains matériaux fluorescence sans pour autant passer les couches tissulaires de la peau, et sont sans danger. D’autres, d’une plus haute fréquence sont les artisans de nos coups de soleil et des dégâts effectués sur la peau. Ils ne sont capables que de traverser nos épidermes.

Au-dessus les ultraviolets, il est possible de trouver les rayons X qui provoque des irradiations et des mutations. Ils sont toutefois fort utiles puisqu’ils traversent une bonne partie des matières vivantes. Ils ne sont néfastes qu’en grosse quantité et sous la forme d’expositions régulières et répétées. C’est la raison pour laquelle vous êtes invité à ne pas suivre vos proches lors de radiographies et que les personnels portent des protections en plomb.

Au-dessus de ces ondes, les rayons gamma sont de fréquence très élevées et de grande énergie. Ce sont les rayonnements stellaires les plus dangereux car ils traversent et modifient grandement la matière, en particulier vivante, voir la détruisent.

A l’autre bout du spectre visible, et au-dessous de la lumière rouge se trouvent les Infrarouge, puis les micro-ondes, les bandes de « radiofréquences » telles que la FM ou l’AM et les infrasons. Ce sont ces zones qui vont nous intéresser par la suite.

Ces fréquences d’ondes ne sont pas ionisantes, ce qui limitent leur létalité. Toutefois, il faut se souvenir que toutes les ondes sont des perturbations de l’environnement, suivant leurs puissances, elles peuvent l’affecter de façon néfaste. C’est d’ailleurs par ce biais que l’on a créé un effet lié au micro-ondes : un four qui n’utilise pas de résistance.

Pour l’anecdote, votre four à microondes n’étant pas ionisant, vous ne risquez pas le cancer en restant prêts de lui. Par ailleurs, les parois de celui-ci vous protègent des micro-ondes par le biais de l’effet « cage de Faraday ». C’est la raison pour laquelle vous n’êtes pas brulé par les ondes depuis l’extérieur du four. Cela ne signifie pas que l’intérieur de celui-ci est sans danger : les micro-ondes, à forte puissance, provoquent une agitation des molécules d’eau – en particulier – et un échauffement proportionnel à la capacité de son magnétron, on parle, ici, d’onde de 2.45 Mhz, comme celle du WiFi, mais avec une puissance de 750 à 1500 W alors que votre box internet transmet à une puissance de 1 µW – c’est-à-dire 0.000000001 W.

Il faut aussi savoir que c’est bien un échauffement thermique que l’on subit à la proximité d’une antenne WiFi ou d’un téléphone en radiofréquences 4G – 5G : l’élévation est en moyenne de 1 W/kg, c’est le débit d’absorption spécifique ou DAS, réglementé en France à un maximum de 2W/kg. La plupart des téléphones actuellement sur le marché ont un impact inférieur à cette norme souvent en dessous de 1 W/kg voir pour les meilleurs en dessous de 0.5 W/kg. Dans l’ensemble, l’absorption est généralement très faible.

Malheureusement, il est difficile actuellement de trouver un consensus scientifique sur l’utilisation des appareils portés à l’oreille (téléphone / phablette) sur le cerveau. En effet, le DAS mesure un état «fixe» sur un corps uniforme sans mouvement. Ce qui ne veut pas dire grand-chose au niveau de l’être humain. Il est donc préférable d’éloigner le téléphone de son corps (ou plus exactement des organes principaux : Cerveau, hanche, cœur… autant que possible et d’utiliser un kit main-libre pour appeler.

Ce qu’il faut retenir :

- Quand on parle d’onde, on parle d’une déformation d’un milieu par une action, les vagues sur l’océan sont des ondes,

- La plus connue des ondes est la lumière, même si cette onde possède des propriétés semblables à une particule : corpuscule que l’on appelle le photon,

- Les ondes électromagnétiques existent naturellement,

- Un bouclier électromagnétique protège naturellement la terre des rayonnements nocifs, particulièrement des ions et les rayons gamma,

- Le soleil produit des ondes aux effets positifs et négatifs : les ondes thermiques (IR), des ondes lumineuses et des ondes ionisantes, les UV, X et Ɣ, dangereux pour la santé,

- Dans la gamme des ondes les moins dangereuses se trouvent les micro-ondes contrairement à ce que l’on pense. Elles se traduisent par une élévation de la température de l’eau dans les corps vivants. Il faut une grande puissance pour que ces ondes soient brûlantes.

- Les ondes électromagnétiques les plus dangereuses provoquent des irradiations et pénètrent profondément dans la matière, y compris inerte. Les rayons X, permettant de faire des radiographies, sont de ce type, raison pour laquelle on ne vous fait pas passer de radiographie pour rien. Les rayons Ɣ – gamma – produit naturellement par plusieurs corpuscules célestes mais aussi par certaines manipulations d’éléments radioactifs – sont les rayonnements les plus dangereux du spectre. Toutefois, ils sont aussi utilisés en médecine en raison de leur très fort pouvoir pénétrant et stérilisant.

- Les gammes d’ondes utilisées pour la communication par radiofréquences – plus souvent appelé communication « sans fil » – sont à l’autre bout du spectre autour des micro-ondes. Elles passent peu à travers la matière et peuvent être utilisées pour envoyer des informations.

- Toutes les technologies ‘sans fil’ utilisent les ondes comme moyen de transport, aussi le bluetooth de vos enceintes ou de votre montre connectée, votre autoradio, votre smartphone, votre téléphone sans fil, votre télécommande de télévision, votre souris sans fil, sont des exemples de l’utilisation que nous faisons des différentes fréquences de radiodiffusion. (A suivre dans l’article 1.1).

Pour en savoir plus et sources :

Avis de l’agence nationale de sécurité sanitaire (ANSES) 10-2013

WiFi, Santé et Législation : Adrien GAILLARD – 03/04/2018

Applications des rayonnements – CEA

Conférence de l’ASTEC – Les effets électromagnétiques sur le vivant – TenL#72 – Anne PERRIN

Les ondes 1.1 – Les radiofréquences

La radio, les DECT, les Babyphones, les smartphones, le WiFi : https://fr.wikipedia.org/wiki/Micro-onde

Les ondes 1.2 – les rayonnements nocifs

Ionisations, rayonnements X, alpha, beta, gamma…

Les ondes 1.3 – D’autres rayonnements, des ondes venues de l’espace

https://fr.wikipedia.org/wiki/Onde_gravitationnelle

https://fr.wikipedia.org/wiki/Pulsar

https://fr.wikipedia.org/wiki/Quasar

https://fr.wikipedia.org/wiki/Rayonnement_cosmique

dites « Explique-moi l’impact du changement climatique sur les océans en 300 mots maximum. »

dites « Explique-moi l’impact du changement climatique sur les océans en 300 mots maximum. » Cette différence de formulation permet à l’IA de mieux comprendre vos attentes et de fournir une réponse plus ciblée.

Cette différence de formulation permet à l’IA de mieux comprendre vos attentes et de fournir une réponse plus ciblée.

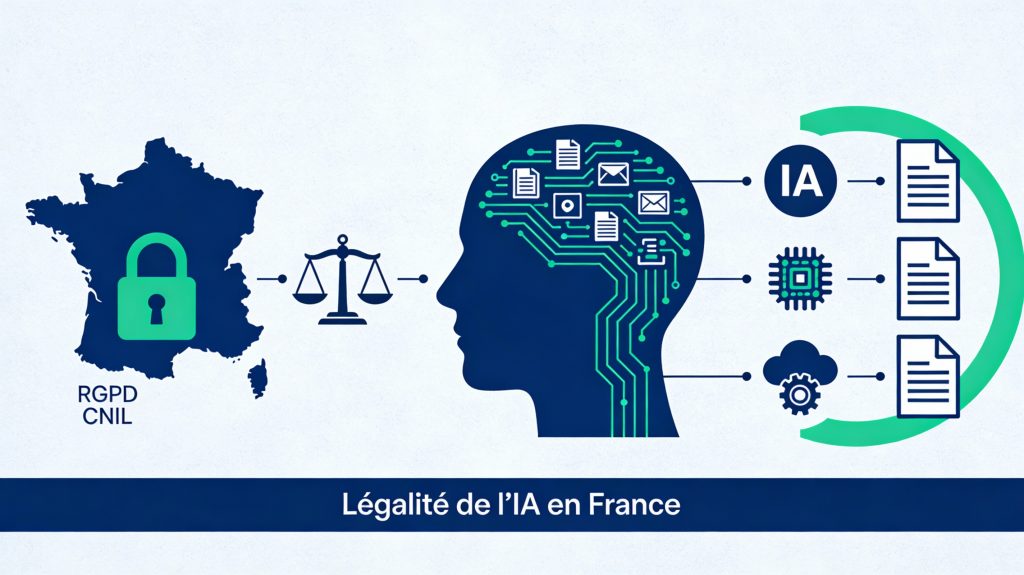

Imaginez que vous essayez de définir « véhicule » : est-ce que cela inclut les voitures, les vélos, les avions, mais aussi les skateboards ou les trottinettes électriques ? Pour l’IA, la définition légale actuelle décrit un « système capable d’apprendre, d’adapter ou d’innover, et susceptible d’avoir des conséquences juridiques ». Mais est-elle suffisamment large pour couvrir toutes les formes d’IA ?

Imaginez que vous essayez de définir « véhicule » : est-ce que cela inclut les voitures, les vélos, les avions, mais aussi les skateboards ou les trottinettes électriques ? Pour l’IA, la définition légale actuelle décrit un « système capable d’apprendre, d’adapter ou d’innover, et susceptible d’avoir des conséquences juridiques ». Mais est-elle suffisamment large pour couvrir toutes les formes d’IA ? Comme nous l’avons vu, l’IA est classée en trois catégories : l’IA en amont (qui collecte et traite les données), l’IA en aval (qui prend des décisions basées sur ces données) et l’IA en itinérance (qui combine les deux). Le défi ici est de réguler chacune de ces formes de manière équilibrée.

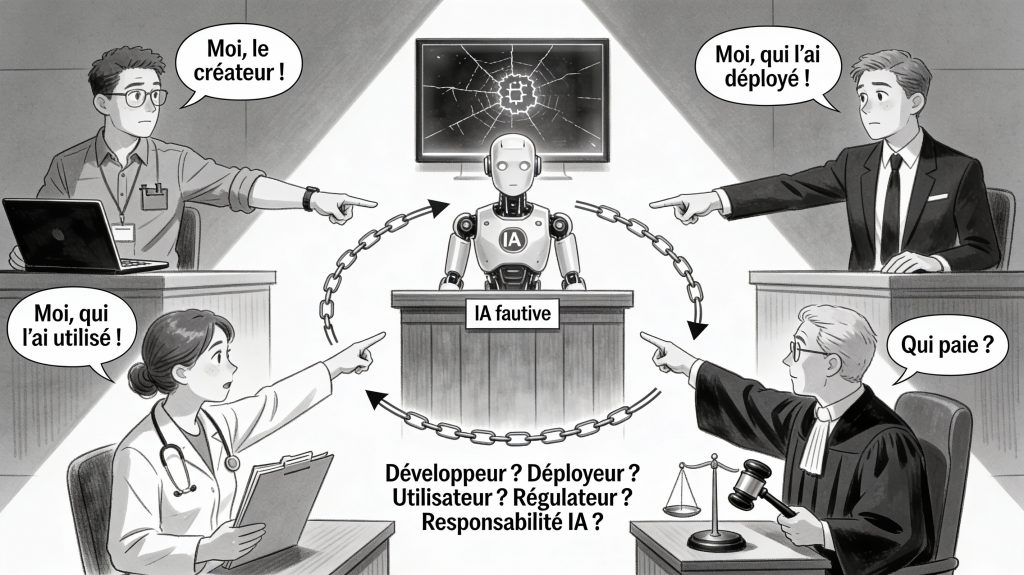

Comme nous l’avons vu, l’IA est classée en trois catégories : l’IA en amont (qui collecte et traite les données), l’IA en aval (qui prend des décisions basées sur ces données) et l’IA en itinérance (qui combine les deux). Le défi ici est de réguler chacune de ces formes de manière équilibrée. Voici une question philosophique et juridique cruciale : si une IA commet une erreur, qui est responsable ? Le programmeur qui l’a créée ? L’entreprise qui la déploie ? Ou l’utilisateur qui l’utilise ?

Voici une question philosophique et juridique cruciale : si une IA commet une erreur, qui est responsable ? Le programmeur qui l’a créée ? L’entreprise qui la déploie ? Ou l’utilisateur qui l’utilise ? L’IA évolue à une vitesse fulgurante : de nouveaux modèles, comme les IA génératives (capables de créer du texte, des images ou de la musique), apparaissent régulièrement. Le défi est que la loi doit suivre ce rythme effréné.

L’IA évolue à une vitesse fulgurante : de nouveaux modèles, comme les IA génératives (capables de créer du texte, des images ou de la musique), apparaissent régulièrement. Le défi est que la loi doit suivre ce rythme effréné. Comment vérifier que l’IA respecte les règles ? C’est là un défi technique et organisationnel majeur. Les IA sont souvent des « boîtes noires » : on sait ce qu’elles font, mais pas toujours comment elles arrivent à leurs conclusions.

Comment vérifier que l’IA respecte les règles ? C’est là un défi technique et organisationnel majeur. Les IA sont souvent des « boîtes noires » : on sait ce qu’elles font, mais pas toujours comment elles arrivent à leurs conclusions. Enfin, certains groupes sont plus exposés aux risques de l’IA : les enfants, les personnes âgées, les minorités, ou les populations défavorisées. Pourquoi ? Parce qu’ils ont souvent moins de moyens pour se défendre ou comprendre les technologies.

Enfin, certains groupes sont plus exposés aux risques de l’IA : les enfants, les personnes âgées, les minorités, ou les populations défavorisées. Pourquoi ? Parce qu’ils ont souvent moins de moyens pour se défendre ou comprendre les technologies.